人工智能

numpy

多线程

ddos

深度优先

桥接模式

flink

MySQL集群搭建

rnn

paas

虚函数表和虚表指针

ps

论文

微信小程序登录

抓包

optee

电路分析

scikit-learn

自动化运维

服务发现

计算机视觉 Computer Vision Chaper6 深度学习基础

相关文章

MFC出现 error RC2108: expected numerical dialog constant错误解决办法

MFC在使用picture console控件之后往往会弹出这个错误:error RC2108: expected numerical dialog constant。 此时,双击这个错误,会跳到提示错误的那一行,在那一行中的一串地址前插入:"Static", SS_BITMAP,

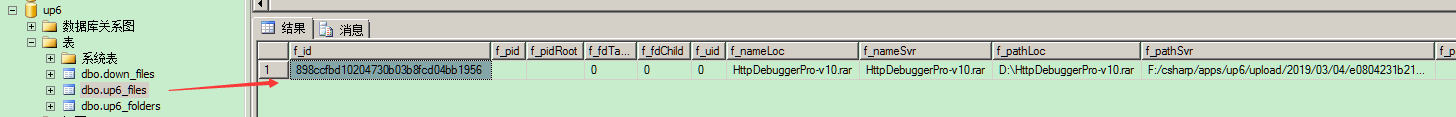

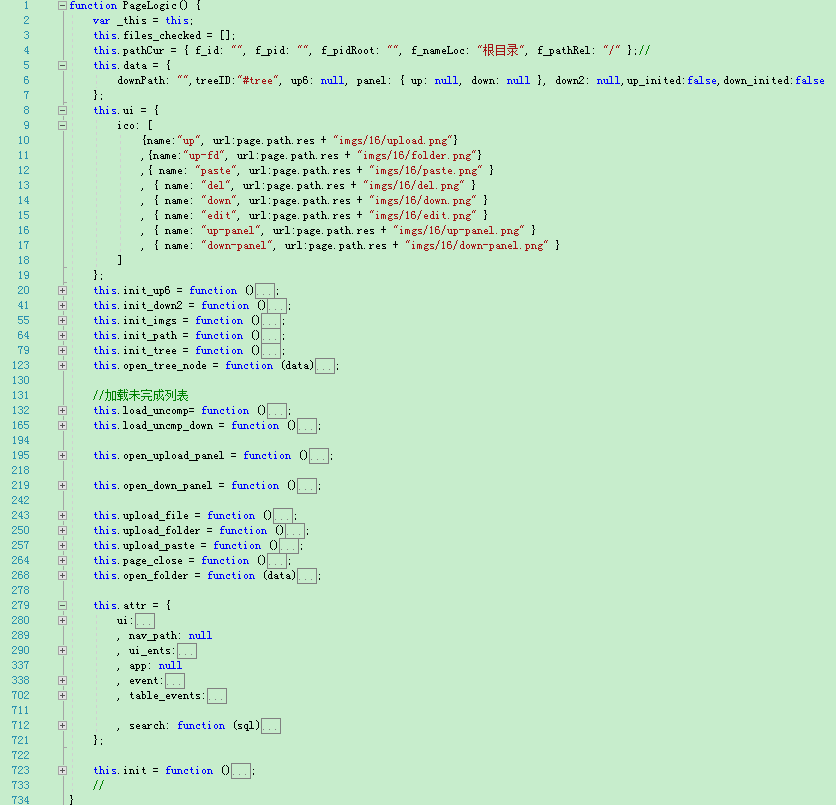

WebUploader 大文件上传下载解决方案

一、概述 所谓断点续传,其实只是指下载,也就是要从文件已经下载的地方开始继续下载。在以前版本的HTTP协议是不支持断点的,HTTP/1.1开始就支持了。一般断点下载时才用到Range和Content-Range实体头。HTTP协议本身不支持断点上传,需…

剑指offer 刷题 四 查找算法(03 53-I 53-II)

剑指 Offer 03. 数组中重复的数字 找出数组中重复的数字。

在一个长度为 n 的数组 nums 里的所有数字都在 0~n-1 的范围内。数组中某些数字是重复的,但不知道有几个数字重复了,也不知道每个数字重复了几次。请找出数组中任意一个重复的数字。…

Web上传大文件的三种解决方案

前言:因自己负责的项目(jetty内嵌启动的SpringMvc)中需要实现文件上传,而自己对java文件上传这一块未接触过,且对 Http 协议较模糊,故这次采用渐进的方式来学习文件上传的原理与实践。该博客重在实践。 一. Http协议原理简介 HTT…

poj2823 Sliding Window

http://poj.org/problem?id2823 单调队列: 1 #include <cstdio>2 #include <cstring>3 #include <algorithm>4 using namespace std;5 const int maxn 1e6 10;6 int a[maxn];7 int n, k;8 int mqx[maxn], idx[maxn], frontx, rearx;//monotone…

计算机视觉 Computer Vision Chaper7 图像分类

文章目录常见CNNAlexnetVGGGoogLeNetResNetResNeXtCNN设计准则常见CNN Alexnet 11的卷积,说明只考虑单一的像素点的多通道,33是考虑了周边的像素点。k是控制升维或者降维的。

VGG GoogLeNet Filter Concatenation 是层数的堆叠,不同于Resnet…

JSP上传大文件的三种解决方案

在Web应用系统开发中,文件上传和下载功能是非常常用的功能,今天来讲一下JavaWeb中的文件上传和下载功能的实现。

先说下要求:

PC端全平台支持,要求支持Windows,Mac,Linux

支持所有浏览器。

支持文件批量上传

支持文件夹上传&…

学习Butterknife的一点心得(系列)二

2019独角兽企业重金招聘Python工程师标准>>> Android Butterknife 是一款不错的注解框架,和我们在运行期处理注解的思想不同,它是在编译期的时候收集注解信息。在系列一中我们讲解了编译注解的原理,ButterKnife的原理和那个例子差…